Accès anticipé : intégration des clients pilotes dès maintenant.

IA privée sur une infrastructure souveraine.

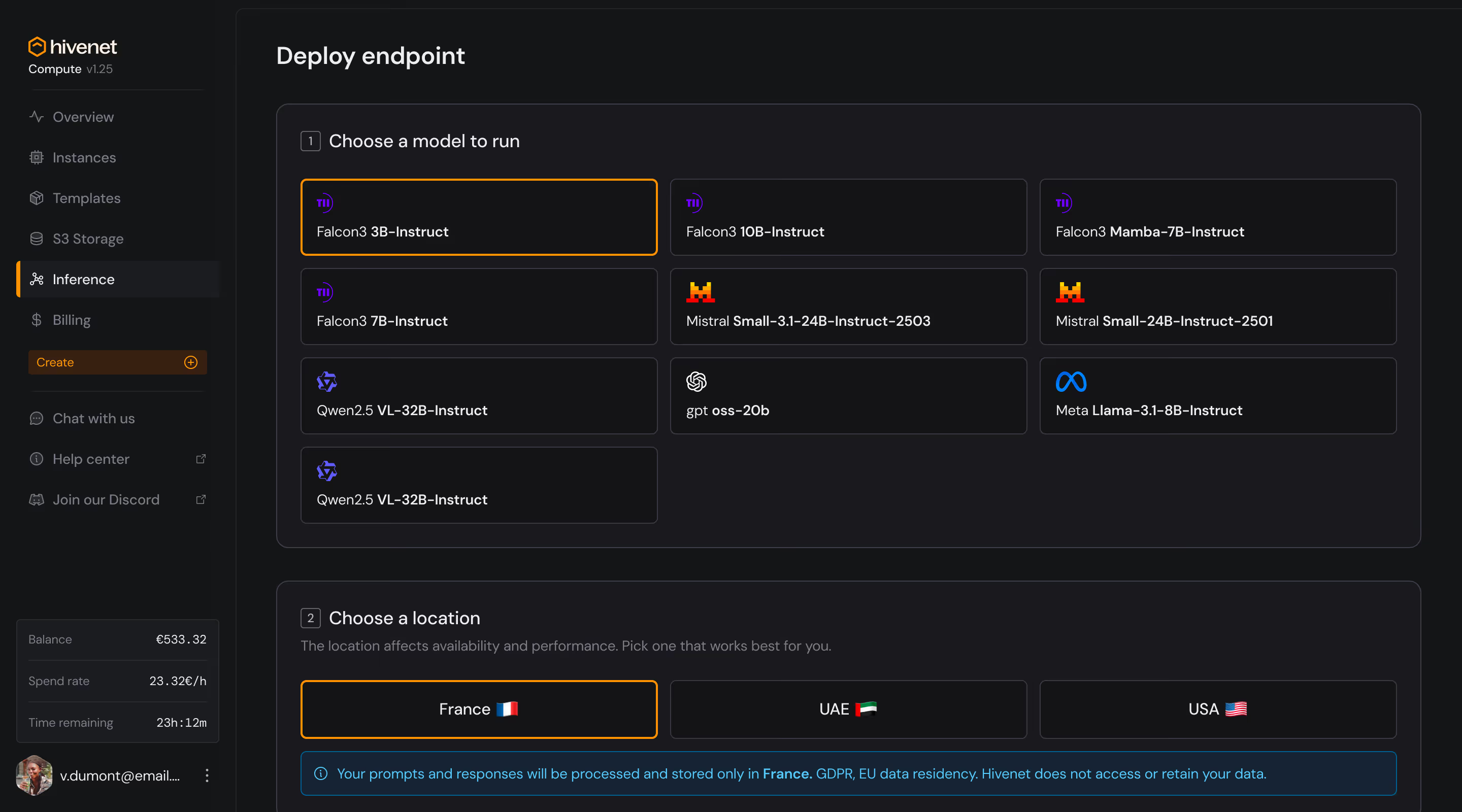

Exécutez des LLM open source sur des GPU RTX 4090 et RTX 5090 dédiés. 45,4 ms TTFT. Vos données ne quittent jamais votre infrastructure. Pas de location partagée. Aucune exposition par des tiers. Juridictions de l'UE, des Émirats arabes unis et des États-Unis.

Ce que Hivenet gère pour vous.

Déployez des modèles de langage open source sur des GPU RTX 4090 ou RTX 5090 dédiés. Facturation à la seconde. Accès contrôlé par une architecture cryptographique, et non par une politique.

Les cas d'utilisation incluent :

Assistants internes et récupération de connaissances sur des données privées.

Récapitulatif des documents pour les industries réglementées.

Outils d'aide à la décision basés sur vos ensembles de données internes.

Comment nous vous accompagnons de la validation de concept à la production.

Sélection et optimisation des modèles

Nous mappons votre charge de travail en fonction du modèle open source et de la configuration GPU appropriés.

Préparation des données

Nous vous aidons à structurer et à sécuriser vos données de formation ou de récupération sur votre infrastructure.

Développement d'applications

Interfaces de discussion, recherche ou outils d'IA personnalisés. Construit sur votre stack.

Déploiement

Déploiement contrôlé avec soutien technique continu. Il ne s'agit pas d'un transfert unique.

La portée et le calendrier du projet pilote sont définis lors de la consultation technique. Si vous savez ce dont vous avez besoin, nous pouvons compresser les étapes.

Votre IA. Vos données. Votre juridiction.

L'accès aux données est limité par l'architecture, et non par la politique. Instance Hivenet privée. Pas de location partagée.

Aucune société mère américaine. Aucune exposition au CLOUD Act. Votre inférence repose sur l'infrastructure de l'UE, des Émirats arabes unis ou des États-Unis, selon votre choix.

Conforme au RGPD. Infrastructure certifiée ISO 27001 (via Policloud). SOC 2 en cours.

Tarification des calculs GPU. Pas de balisage pour les services d'IA.

RTX 5090

1 × - 8 ×

vCPU 8 - - -

RAM 73 - - 584 - GB

Espace disque 250 - - 2000 - GB

Bande passante 1000 - Mo/s

RTX 4090

1 × - 8 ×

vCPU 8 - - -

RAM 48 - - 384 - GB

Espace disque 250 - - 2000 - GB

Bande passante 1000 - Mo/s

Facturation à la seconde. Vous ne payez que pour le temps passé sur le GPU : la couche de services d'IA n'ajoute aucune majoration.

Le soutien technique et l'assistance à la migration sont inclus dans le projet pilote. Aucuns frais de consultation.