Acesso antecipado — clientes piloto se cadastrando agora.

IA privada em infraestrutura soberana.

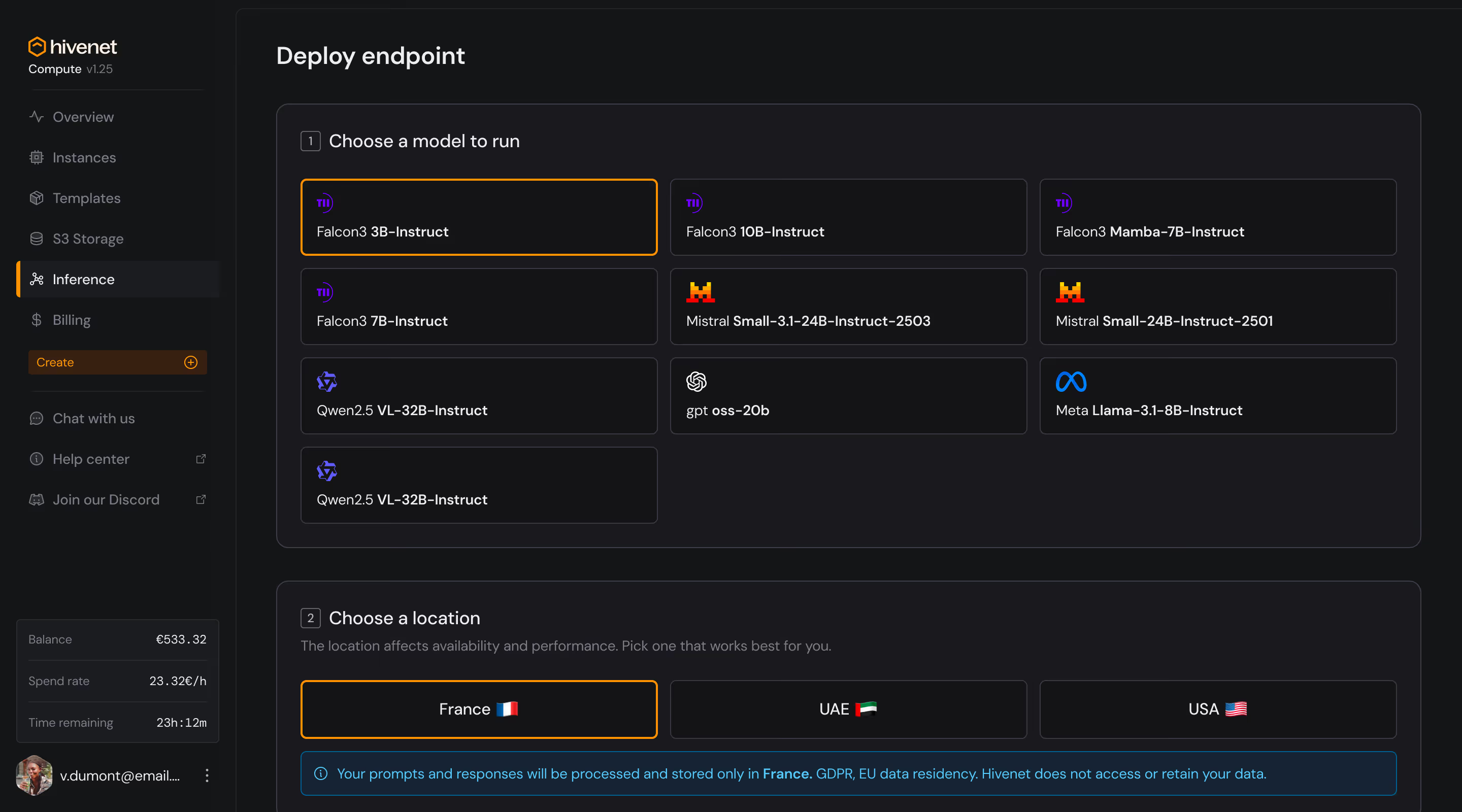

Execute LLMs de código aberto em GPUs RTX 4090 e RTX 5090 dedicadas. TTFT de 45,4 ms. Seus dados nunca saem da sua infraestrutura. Sem locação compartilhada. Sem exposição a terceiros. Jurisdições da UE, Emirados Árabes Unidos e EUA.

O que a Hivenet oferece para você.

Implante modelos de linguagem de código aberto em GPUs RTX 4090 ou RTX 5090 dedicadas. Cobrança por segundo. Acesso controlado pela arquitetura criptográfica — não pela política.

Os casos de uso incluem:

Assistentes internos e recuperação de conhecimento sobre dados privados.

Resumo de documentos para setores regulamentados.

Ferramentas de apoio à decisão baseadas em seus conjuntos de dados internos.

Como levamos você da prova de conceito à produção.

Seleção e otimização de modelos

Mapeamos sua carga de trabalho de acordo com o modelo de código aberto e a configuração de GPU corretos.

Preparação de dados

Ajudamos a estruturar e proteger seus dados de treinamento ou recuperação em sua infraestrutura.

Desenvolvimento de aplicativos

Interfaces de bate-papo, pesquisa ou ferramentas personalizadas de IA. Construído em sua pilha.

Lançamento

Implantação controlada com suporte contínuo de engenharia. Não é uma entrega única.

O escopo e o cronograma do piloto são definidos na consulta técnica. Se você sabe do que precisa, podemos compactar as etapas.

Sua IA. Seus dados. Sua jurisdição.

Acesso aos dados restrito pela arquitetura, não pela política. Instância privada da Hivenet. Sem locação compartilhada.

Nenhuma empresa-mãe dos EUA. Sem exposição à Lei CLOUD. Sua inferência é executada na infraestrutura da UE, Emirados Árabes Unidos ou EUA — sua escolha.

Compatível com o GDPR. Infraestrutura com certificação ISO 27001 (via Policloud). SOC 2 em andamento.

Preços de computação de GPU. Sem marcação de serviços de IA.

RTX 5090

1 × - 8 ×

vCPU 8 - - -

RAM 73 - - 584 - GB

Espaço em disco 250 - - 2000 - GB

Largura de banda 1000 - Mb/s

RTX 4090

1 × - 8 ×

vCPU 8 - - -

RAM 48 - - 384 - GB

Espaço em disco 250 - - 2000 - GB

Largura de banda 1000 - Mb/s

Cobrança por segundo. Você paga somente pelo tempo de GPU — a camada de serviços de IA não adiciona nenhuma marcação.

O suporte de engenharia e a assistência à migração estão incluídos no piloto. Sem taxas de consultoria.