Inferência com computação

Execute a inferência de GPU sem a sobrecarga usual

Inicie cargas de trabalho de inferência nas instâncias RTX 4090 e RTX 5090, comece rapidamente com o vLLM gerenciado e pague somente pelo tempo que usar.

Por que as equipes escolhem a computação para inferência

Inferência gerenciada com vLLM

Comece a servir em minutos com um modelo de vLLM gerenciado em vez de criar toda a camada de serviço do zero.

Preços simples

Use o faturamento por segundo sem cobranças de saída separadas e preços que já incluem computação, armazenamento e volume de rede.

Rede flexível

Exponha as portas de que seu serviço precisa e execute com HTTPS, TCP ou UDP.

Opções de implantação regional

Execute cargas de trabalho mais perto de onde seus usuários e sistemas operam quando as opções de latência e implantação são importantes.

Como funciona

Escolha a camada 4090 ou 5090 que se adapte ao seu modelo e perfil de tráfego.

Inicie a partir de uma imagem PyTorch ou vLLM limpa e comece com uma configuração que já corresponda ao trabalho.

Ative HTTPS, TCP ou UDP e direcione seu aplicativo para o endpoint de que ele precisa.

Transforme sua configuração em um modelo personalizado para que o próximo lançamento dê menos trabalho.

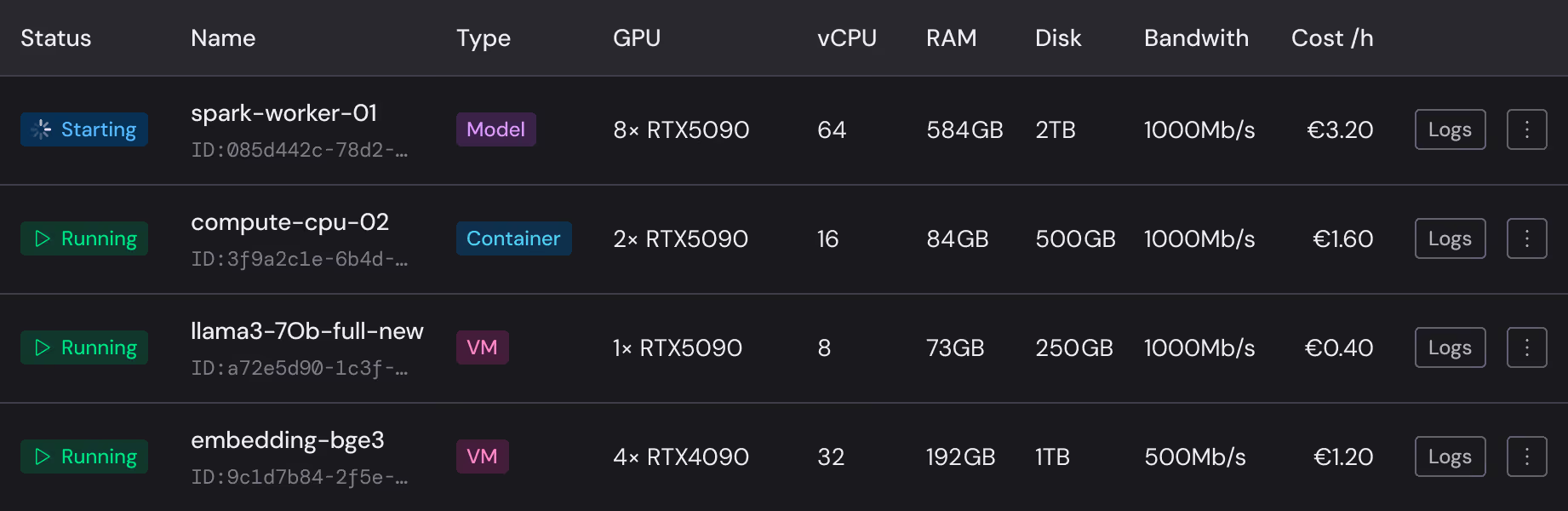

O que as pessoas usam no Compute

IA conversacional para suporte e tutoria

Endpoints LLM ajustados para aplicativos e APIs

Modelos de voz para transcrição ou legendas em tempo real

Visão geral dos preços

As cargas de trabalho de inferência geralmente passam longos períodos ociosas, o que faz com que o modelo de preços seja tão importante quanto a velocidade bruta da GPU. A computação simplifica isso com cobrança por segundo e preços agrupados.

RTX 5090

1 × - 8 ×

vCPU 8 - - -

RAM 73 - - 584 - GB

Espaço em disco 250 - - 2000 - GB

Largura de banda 1000 - Mb/s

RTX 4090

1 × - 8 ×

vCPU 8 - - -

RAM 48 - - 384 - GB

Espaço em disco 250 - - 2000 - GB

Largura de banda 1000 - Mb/s

Comece o autoatendimento, vá mais fundo quando necessário

Experimente o Compute diretamente se quiser testar os preços, a configuração e o fluxo de trabalho de inferência adequados para você. Converse com a equipe de vendas se sua equipe precisar de planejamento regional, implantações maiores ou uma implantação mais estruturada. Os documentos estão lá quando você quer se mover mais rápido.