Inferencia con cómputos

Ejecute la inferencia de GPU sin la sobrecarga habitual

Lance cargas de trabajo de inferencia en instancias RTX 4090 y RTX 5090, comience rápidamente con una VLLM gestionada y pague solo por el tiempo que utilice.

Por qué los equipos eligen Compute para la inferencia

Inferencia gestionada con vLLM

Empieza a publicar en cuestión de minutos con una plantilla vLLM gestionada en lugar de crear toda la capa de publicación desde cero.

Precios sencillos

Utilice la facturación por segundo sin cargos de salida separados y precios que ya incluyen el volumen de procesamiento, almacenamiento y red.

Redes flexibles

Exponga los puertos que necesita su servicio y ejecútelos con HTTPS, TCP o UDP.

Opciones de despliegue regional

Ejecute las cargas de trabajo más cerca de donde operan sus usuarios y sistemas cuando las opciones de latencia e implementación sean importantes.

Cómo funciona

Elija el nivel 4090 o 5090 que se adapte a su modelo y perfil de tráfico.

Inicie desde una imagen limpia de PyTorch o vLLM y comience con una configuración que ya coincida con el trabajo.

Habilite HTTPS, TCP o UDP y dirija su aplicación al punto final que necesita.

Convierte tu configuración en una plantilla personalizada para que el próximo lanzamiento lleve menos trabajo.

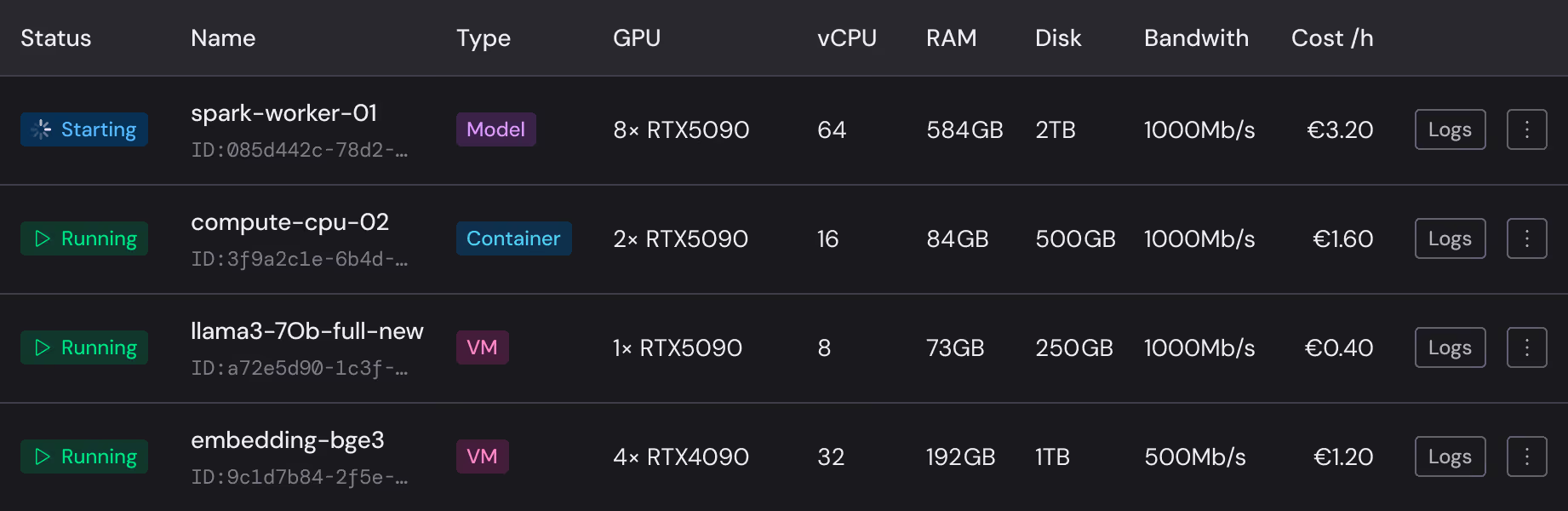

Qué usan las personas en Compute

IA conversacional para apoyo y tutoría

Terminales de LLM optimizados para aplicaciones y API

Modelos de voz para transcripciones o subtítulos en tiempo real

Los precios de un vistazo

Las cargas de trabajo de inferencia suelen permanecer inactivas durante largos períodos, lo que hace que el modelo de precios importe tanto como la velocidad bruta de la GPU. Compute simplifica esta tarea con la facturación por segundo y los precios combinados.

RTX 5090

1 × - 8 ×

vCPU 8 - - -

CARNERO 73 - - 584 - GB

Espacio en disco 250 - - 2000 - GB

Ancho de banda 1000 - MB/s

RTX 4090

1 × - 8 ×

vCPU 8 - - -

CARNERO 48 - - 384 - GB

Espacio en disco 250 - - 2000 - GB

Ancho de banda 1000 - MB/s

Comience con el autoservicio y profundice cuando sea necesario

Prueba Compute directamente si quieres probar que los precios de inferencia, la configuración y el flujo de trabajo son adecuados para ti. Habla con el departamento de ventas si tu equipo necesita una planificación regional, despliegues de mayor envergadura o un despliegue más estructurado. Los documentos están ahí cuando quieres avanzar más rápido.