Inférence avec calcul

Exécutez l'inférence GPU sans les frais habituels

Lancez des charges de travail d'inférence sur des instances RTX 4090 et RTX 5090, démarrez rapidement avec le vLLM géré et ne payez que pour le temps que vous utilisez.

Pourquoi les équipes choisissent Compute pour l'inférence

Inférence gérée avec vLLM

Commencez à diffuser en quelques minutes avec un modèle vLLM géré au lieu de créer toute la couche de service à partir de zéro.

Tarification simple

Utilisez la facturation à la seconde sans frais de sortie distincts et une tarification qui inclut déjà le calcul, le stockage et le volume du réseau.

Mise en réseau flexible

Exposez les ports dont votre service a besoin et exécutez-le en HTTPS, TCP ou UDP.

Options de déploiement régional

Exécutez les charges de travail plus près de l'endroit où vos utilisateurs et vos systèmes fonctionnent lorsque les choix en matière de latence et de déploiement sont importants.

Comment ça marche

Choisissez le niveau 4090 ou 5090 qui correspond à votre modèle et à votre profil de trafic.

Lancez à partir d'une image PyTorch ou vLLM propre et commencez par une configuration qui correspond déjà à la tâche.

Activez HTTPS, TCP ou UDP et dirigez votre application vers le terminal dont elle a besoin.

Transformez votre configuration en un modèle personnalisé pour que le prochain lancement soit moins fastidieux.

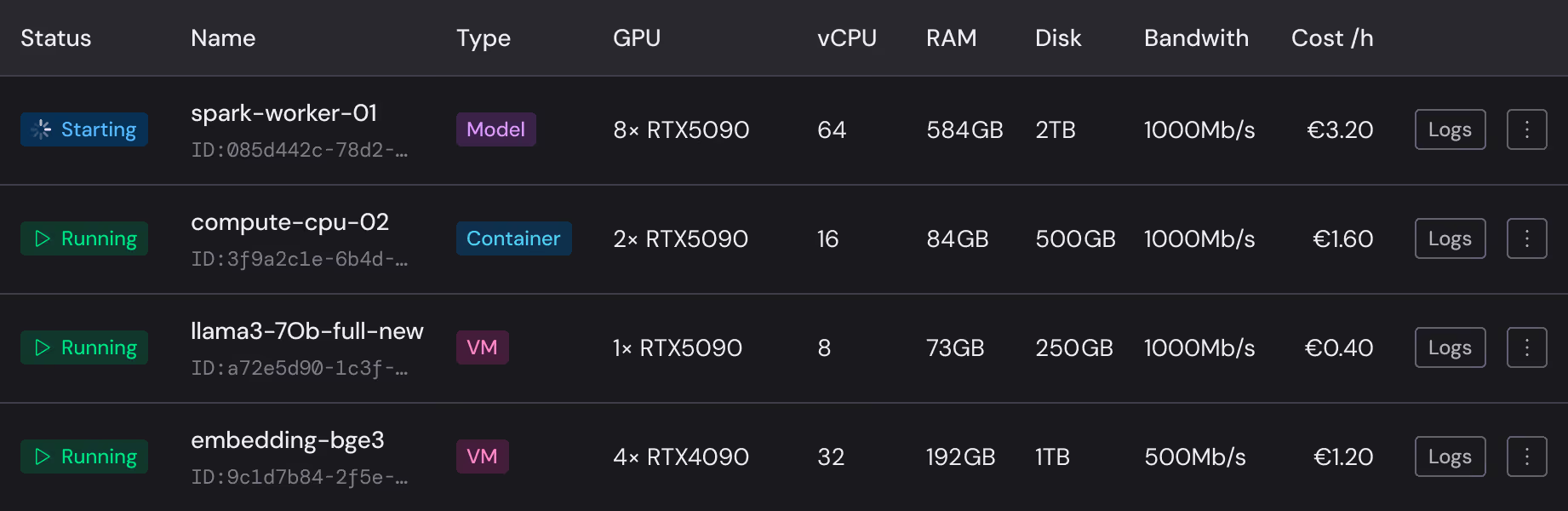

Ce que les gens utilisent sur Compute

L'IA conversationnelle pour le soutien et le tutorat

Terminaux LLM adaptés aux applications et aux API

Modèles vocaux pour la transcription ou les sous-titres en temps réel

Les prix en un coup d'œil

Les charges de travail d'inférence restent souvent inactives pendant de longues périodes, ce qui fait que le modèle de tarification est aussi important que la vitesse brute du GPU. Compute simplifie les choses grâce à la facturation à la seconde et à la tarification groupée.

RTX 5090

1 × - 8 ×

vCPU 8 - - -

RAM 73 - - 584 - GB

Espace disque 250 - - 2000 - GB

Bande passante 1000 - Mo/s

RTX 4090

1 × - 8 ×

vCPU 8 - - -

RAM 48 - - 384 - GB

Espace disque 250 - - 2000 - GB

Bande passante 1000 - Mo/s

Démarrez le libre-service, approfondissez vos connaissances si nécessaire

Essayez Compute directement si vous souhaitez tester la tarification, la configuration et le flux de travail d'inférence qui vous conviennent. Adressez-vous au service commercial si votre équipe a besoin d'une planification régionale, de déploiements plus importants ou d'un déploiement plus structuré. Les documents sont là quand vous voulez aller plus vite.