Computação com Hivenet

Ajuste e treine modelos de IA com GPUs em nuvem de alto desempenho

Amplie seus fluxos de trabalho de IA com GPUs acessíveis e de alto desempenho. Ajuste o Mistral, o LLAMA e muito mais em minutos usando nossa computação baseada em nuvem. Acesse as poderosas Nvidia RTX 4090 e RTX 5090 para treinamento e inferência de IA perfeitos.

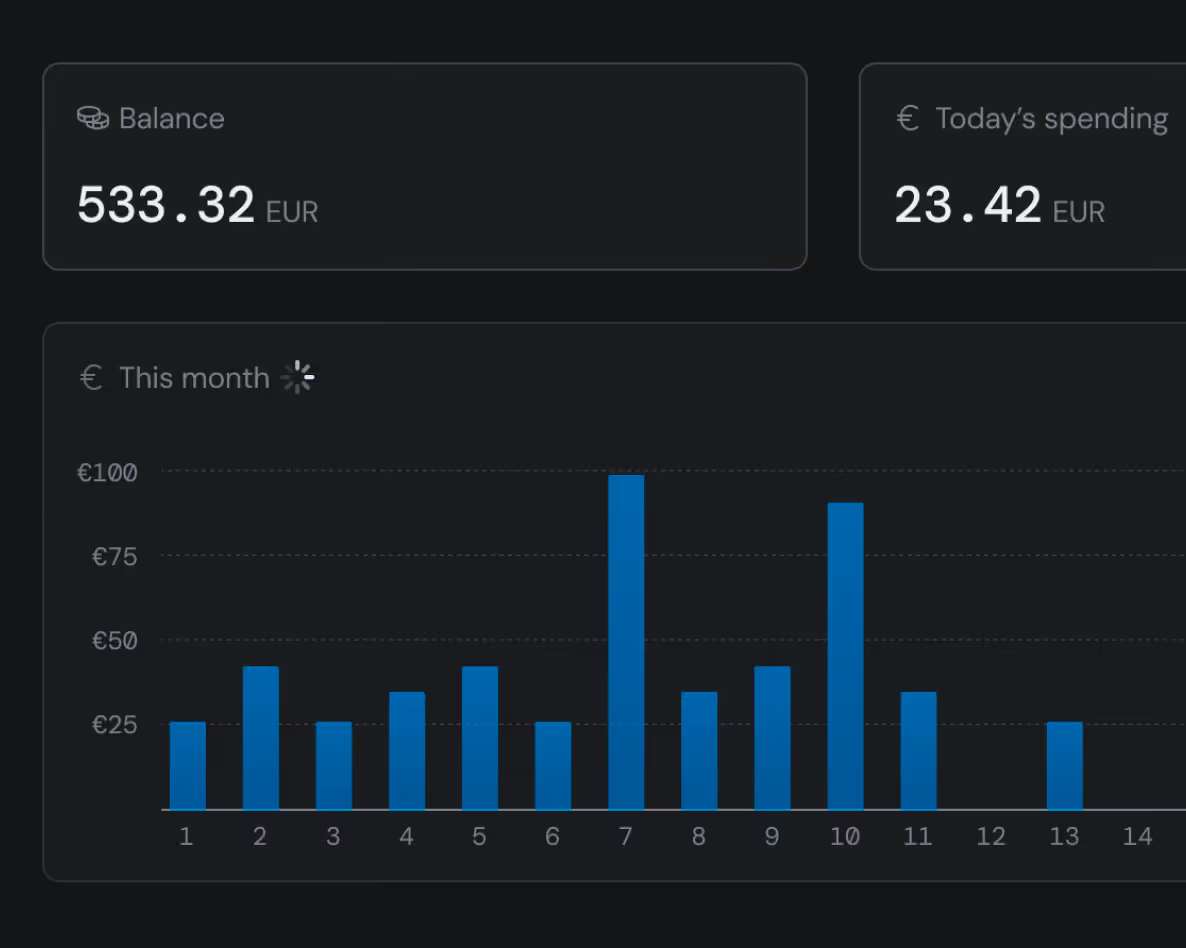

Economize até 70% em comparação com os principais provedores de nuvem

Pague apenas pelo que você usa, até o segundo.

Sem taxas ocultas, sem compromissos de longo prazo.

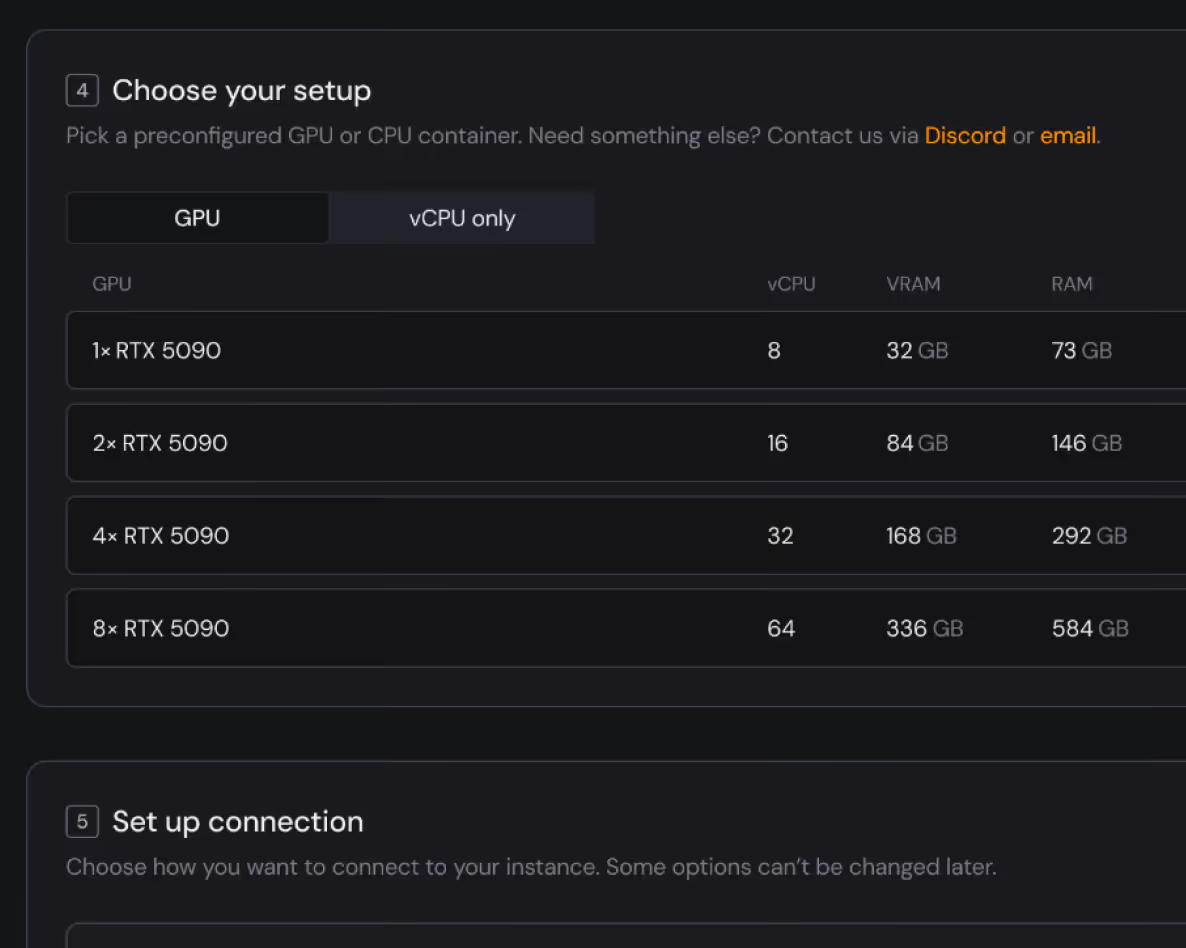

RTX 5090

1 ×

vCPU -

RAM 73 - GB

Espaço em disco 250 - GB

Largura de banda 1000 - Mb/s

€0,40/h

2 ×

vCPU -

RAM 146 - GB

Espaço em disco 500 - GB

Largura de banda 1000 - Mb/s

€0,80/h

4 ×

vCPU -

RAM 292 - GB

Espaço em disco 1000 - GB

Largura de banda 1000 - Mb/s

€1,60/h

8 ×

vCPU -

RAM 584 - GB

Espaço em disco 2000 - GB

Largura de banda 1000 - Mb/s

€3,20/h

RTX 4090

1 ×

vCPU -

RAM 48 - GB

Espaço em disco 250 - GB

Largura de banda 125 - Mb/s

€0,20/h

2 ×

vCPU -

RAM 96 - GB

Espaço em disco 500 - GB

Largura de banda 250 - Mb/s

€0,40/h

4 ×

vCPU -

RAM 192 - GB

Espaço em disco 1000 - GB

Largura de banda 500 - Mb/s

€0,80/h

8 ×

vCPU -

RAM 384 - GB

Espaço em disco 2000 - GB

Largura de banda 1000 - Mb/s

€1,60/h

Quem roda no Compute com a Hivenet

Pesquisadores, startups, estúdios e equipes corporativas executam cargas de trabalho de produção nessa infraestrutura. Não é uma caixa de areia.

A computação tem tudo o que você precisa necessidades de carga de trabalho

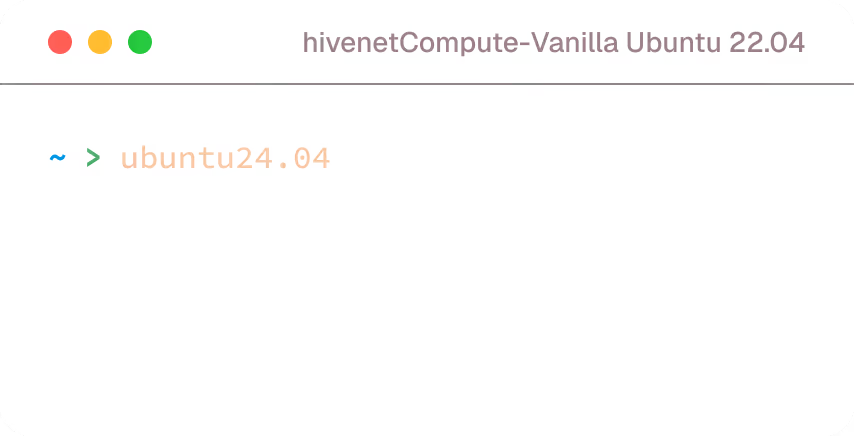

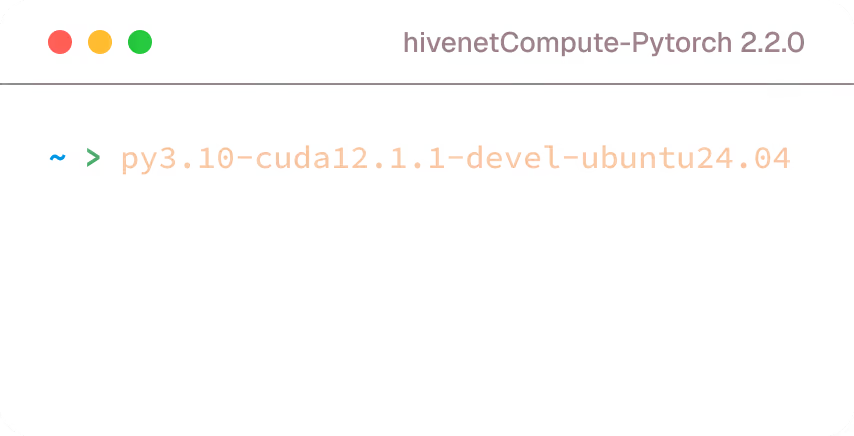

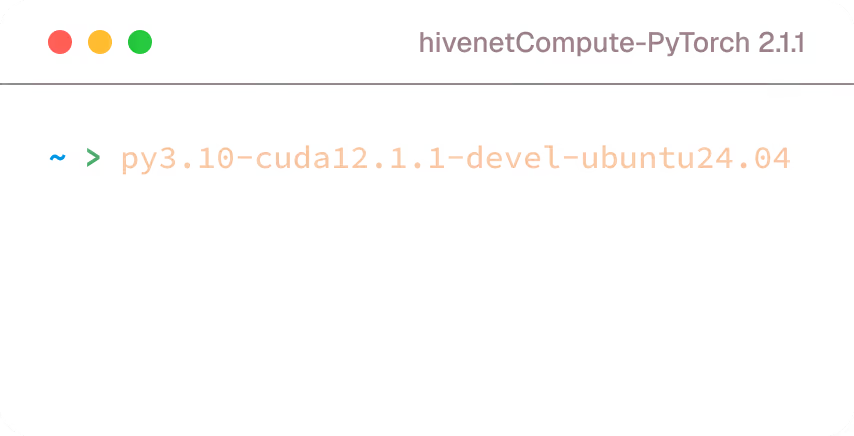

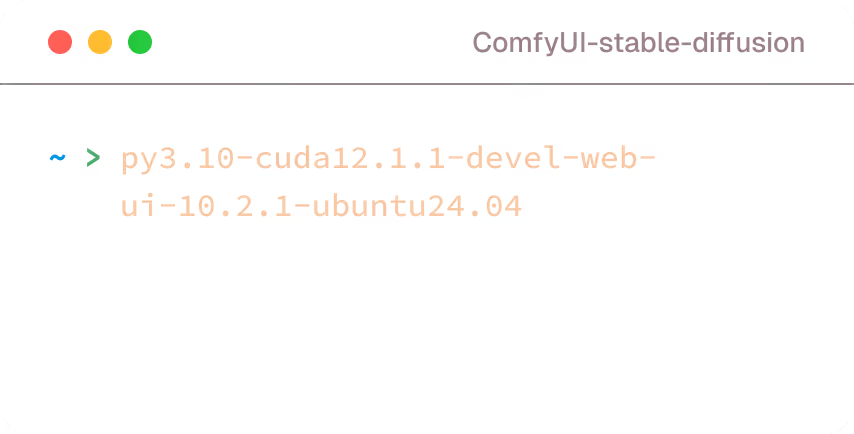

Comece em segundos

Comece a treinar seu modelo imediatamente após se inscrever

Pré-carregado com as estruturas de ML corretas.

Acesso root, conecte-se com SSH.

Configuração rápida e simples.

GPUs acessíveis com cobrança por segundo

Sem custos ocultos. Preços simples e competitivos

Sem custos de entrada/saída.

Sem custos extras para RAM, vCPU ou armazenamento.

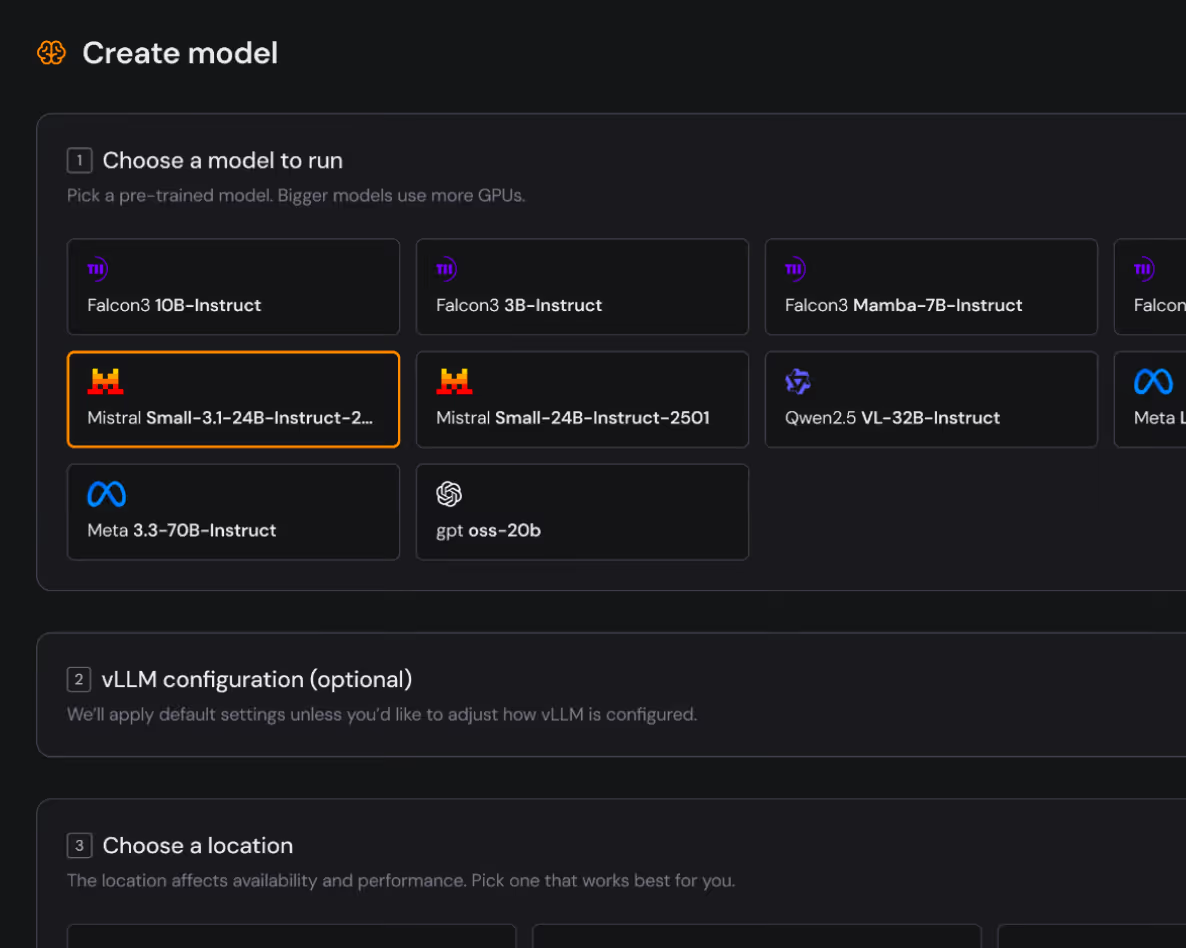

Inferência gerenciada com vLLM

Inicie um servidor vLLM com alguns cliques

Inicie um servidor vLLM com alguns cliques. Defina a janela de contexto e a simultaneidade, transmita tokens e mantenha a alta taxa de transferência com lotes contínuos

Corra cargas de trabalho intensivas com confiança

Escolha a configuração correta de ML para suas necessidades de treinamento em IA

Melhores GPUs para Inferência de IA.

Não perca essa oportunidade de escalar seus fluxos de trabalho com desempenho e economia incomparáveis.